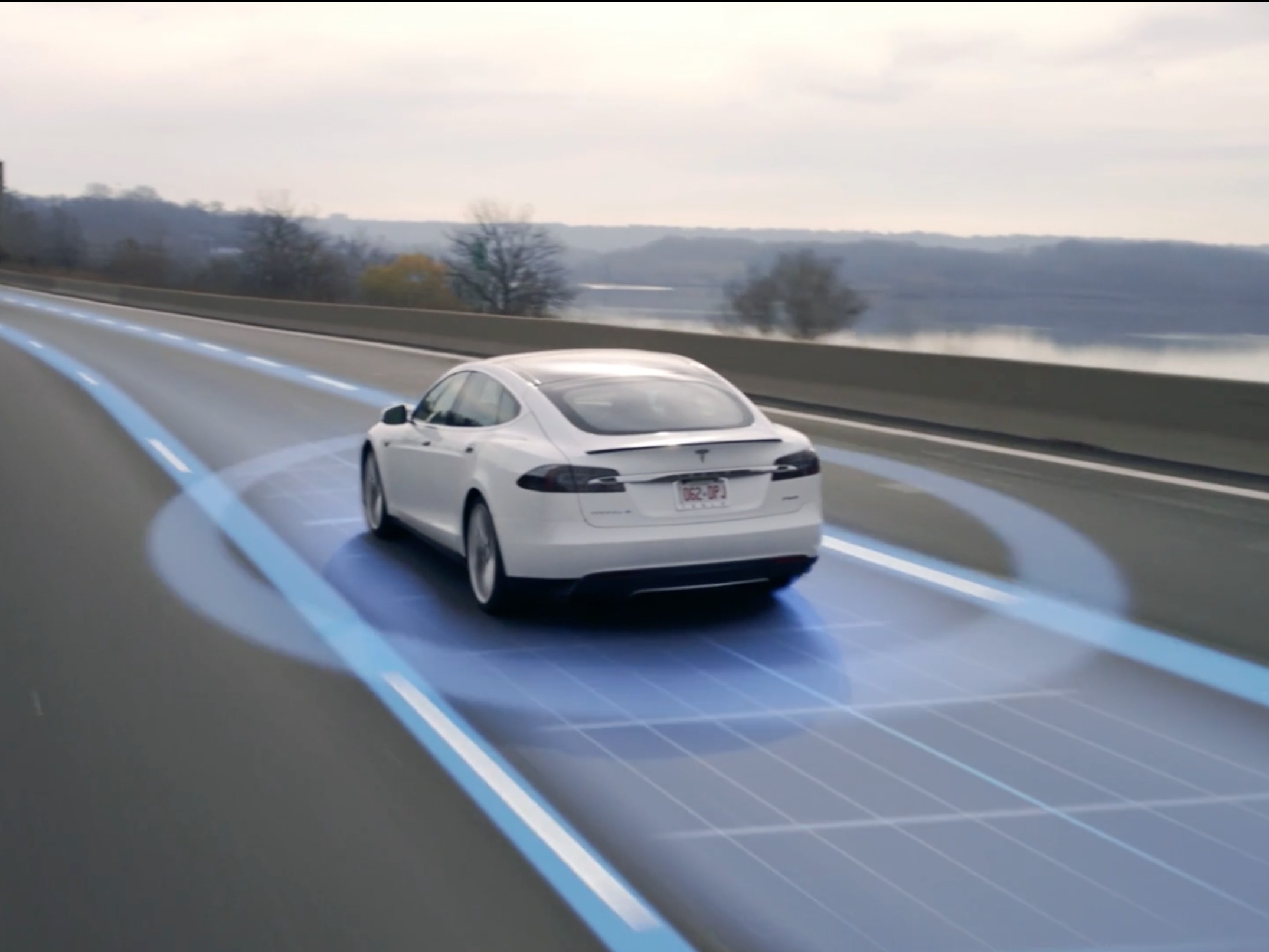

Khía cạnh đạo đức khi phát triển hệ thống xe tự lái?

Tình huống: chiếc xe tự lái hoàn toàn bằng Trí tuệ nhân tạo, trên xe chở 4 người. Tình cờ chiếc xe đó trên một đoạn cua gấp nhìn thấy 1 người đang đi bộ qua đường, nó sẽ phải quyết định làm gì? A - lao vào tường để tránh người đi bộ, làm 4 hành khách tử nạn và B - đâm chết người đi bộ kia. Chiếc xe chỉ có thể thực hiện A hoặc B chứ không thể có một giải pháp tối ưu hơn.

Bạn sẽ xử lí như thế nào nếu :

_ Bạn là nhà phát triển xe tự lái đó?

_ Bạn là người mua sản phẩm xe tự lái? Liệu bạn có chấp nhận mua 1 chiếc xe sẽ hi sinh người trên xe?

_ Bạn là người nhà của nạn nhân? Bạn sẽ kiện ai? Bên phát triển xe hay bên phía còn lại?

xe tự lái

,trí tuệ nhân tạo

,đạo đức

,kiến thức chung

Mình nghĩ trường hợp này sẽ ko xảy ra. Vì khi viết phần mềm điều khiển AI sẽ được học luật và tuân theo đúng luật giao thông.

Trường hợp 1. Khả dĩ nhất. Tất cả đều đi đúng luật -> ko có tai nạn

Trường hợp 2. Ng đi bộ sai luật. (Ngay trong ví dụ, qua đường ở ngay khúc cua mà ko quan sát, vậy là ko đúng rồi, và AI qua cua cũng sẽ giảm tốc độ chứ ko chạy cắm mặt như ng thường. Nhưng vấn đề này sẽ ko tính đến). Lúc đó, có lẽ AI sẽ có phương án xử lý tốt nhất để đảm bảo an toàn cho mọi ng, hoặc ít nhất là ng đúng luật. Và con ng phải mất ít nhất 1s để đưa ra quyết định, nhưng AI đủ mạnh, nó có thể đưa ra quyết định sớm hơn rất nhiều. Ở 36km/h, 1s đồng nghĩa 10m. Nhưng tất nhiên ko thể nào 100% đc -> nếu có tai nạn, ng đi bộ chịu trách nhiệm.

Trường hợp 3. Ng trên xe yêu cầu ghi đè lệnh điều khiển đối với AI -> ng thực hiện hành động chịu.

Trường hợp 4. Xe bị hỏng hóc, lỗi phần cứng hoặc phần mềm. Trách nhiệm sẽ đc xem xét hỏng hóc, lỗi do đâu và sẽ có ng chịu trách nhiệm, chủ xe hoặc nhà sản xuất.

Trường hợp 5. AI chưa hoàn thiện, hoặc có lỗi trong hệ thống -> nhà sản xuất chịu.

Như vậy, để giữ vấn đề đạo đức.

- AI tất nhiên sẽ hoạt động theo đúng luật và rõ ràng AI sẽ xử lý nhanh hơn con người. Còn xử lý như thế nào thì sẽ do ng viết phần mềm.

- Nhà sản xuất phải hoàn thiện AI của mình, phải qua các khâu kiểm tra, kiểm định kỹ càng (tất nhiên ko có chuyện bỏ bì để đóng dấu đâu).

- Ng sở hữu sẽ có nhiệm vụ bảo trì, bảo dưỡng, cập nhật,... để xe hoàn hảo nhất và tự chịu trách nhiệm nếu chiếm quyền điều khiển của AI.

- Ng đi bộ sẽ cố gắng đúng luật.

Mình nghĩ tai nạn sẽ chỉ xảy ra khi có ng sai và việc AI hay con ng điều khiển thì ai đúng ai sai vẫn rõ ràng. Mà AI như đã nói ở trên, nó xử lý nhanh hơn, nguyên tắc hơn, nên nó sẽ an toàn hơn. Bạn xem phim I, Robot của Will Smith ý. Lúc Will đc 1 con robot cứu vì rơi xuống sông, cũng có 1 cô bé ở chiếc xe chìm phía dưới nữa. Con robot nó chọn cứu Will chứ ko cứu cô bé ở dưới, mặt dù Will bảo nó cứu cô bé. Nhưng cứu cô bé thì xác suất chết cả Will và cô bé kia rất lớn. Vậy thì, là con ng bạn sẽ cứu ai trong trường hợp trên nếu bạn đã biết các thông số? Trong các phương án tệ thì hầu như ai cũng vậy, sẽ chọn phương án ít tệ hại nhất và lấy đó làm phương án tối ưu.

Nếu chỉ có 2 phương án. Chắc chắn ko chỉ AI mà cả con ng cũng sẽ chọn phương án B thôi. Vụ container đâm ng dừng đèn đỏ gần đây là vậy đó. Họ trách tài xế sao ko đâm vào xe bê-tông, nhưng giỏi lên cầm vô-lăng rồi nói. Còn phương án A cũng có như a tài xế xe chở đá bẻ cua cứu 2 cô gái, và nếu cách đây chục năm chưa có fb thì ai cứu cuộc đời a?

Nguyễn Quang Vinh

Mình nghĩ trường hợp này sẽ ko xảy ra. Vì khi viết phần mềm điều khiển AI sẽ được học luật và tuân theo đúng luật giao thông.

Trường hợp 1. Khả dĩ nhất. Tất cả đều đi đúng luật -> ko có tai nạn

Trường hợp 2. Ng đi bộ sai luật. (Ngay trong ví dụ, qua đường ở ngay khúc cua mà ko quan sát, vậy là ko đúng rồi, và AI qua cua cũng sẽ giảm tốc độ chứ ko chạy cắm mặt như ng thường. Nhưng vấn đề này sẽ ko tính đến). Lúc đó, có lẽ AI sẽ có phương án xử lý tốt nhất để đảm bảo an toàn cho mọi ng, hoặc ít nhất là ng đúng luật. Và con ng phải mất ít nhất 1s để đưa ra quyết định, nhưng AI đủ mạnh, nó có thể đưa ra quyết định sớm hơn rất nhiều. Ở 36km/h, 1s đồng nghĩa 10m. Nhưng tất nhiên ko thể nào 100% đc -> nếu có tai nạn, ng đi bộ chịu trách nhiệm.

Trường hợp 3. Ng trên xe yêu cầu ghi đè lệnh điều khiển đối với AI -> ng thực hiện hành động chịu.

Trường hợp 4. Xe bị hỏng hóc, lỗi phần cứng hoặc phần mềm. Trách nhiệm sẽ đc xem xét hỏng hóc, lỗi do đâu và sẽ có ng chịu trách nhiệm, chủ xe hoặc nhà sản xuất.

Trường hợp 5. AI chưa hoàn thiện, hoặc có lỗi trong hệ thống -> nhà sản xuất chịu.

Như vậy, để giữ vấn đề đạo đức.

- AI tất nhiên sẽ hoạt động theo đúng luật và rõ ràng AI sẽ xử lý nhanh hơn con người. Còn xử lý như thế nào thì sẽ do ng viết phần mềm.

- Nhà sản xuất phải hoàn thiện AI của mình, phải qua các khâu kiểm tra, kiểm định kỹ càng (tất nhiên ko có chuyện bỏ bì để đóng dấu đâu).

- Ng sở hữu sẽ có nhiệm vụ bảo trì, bảo dưỡng, cập nhật,... để xe hoàn hảo nhất và tự chịu trách nhiệm nếu chiếm quyền điều khiển của AI.

- Ng đi bộ sẽ cố gắng đúng luật.

Mình nghĩ tai nạn sẽ chỉ xảy ra khi có ng sai và việc AI hay con ng điều khiển thì ai đúng ai sai vẫn rõ ràng. Mà AI như đã nói ở trên, nó xử lý nhanh hơn, nguyên tắc hơn, nên nó sẽ an toàn hơn. Bạn xem phim I, Robot của Will Smith ý. Lúc Will đc 1 con robot cứu vì rơi xuống sông, cũng có 1 cô bé ở chiếc xe chìm phía dưới nữa. Con robot nó chọn cứu Will chứ ko cứu cô bé ở dưới, mặt dù Will bảo nó cứu cô bé. Nhưng cứu cô bé thì xác suất chết cả Will và cô bé kia rất lớn. Vậy thì, là con ng bạn sẽ cứu ai trong trường hợp trên nếu bạn đã biết các thông số? Trong các phương án tệ thì hầu như ai cũng vậy, sẽ chọn phương án ít tệ hại nhất và lấy đó làm phương án tối ưu.

Nếu chỉ có 2 phương án. Chắc chắn ko chỉ AI mà cả con ng cũng sẽ chọn phương án B thôi. Vụ container đâm ng dừng đèn đỏ gần đây là vậy đó. Họ trách tài xế sao ko đâm vào xe bê-tông, nhưng giỏi lên cầm vô-lăng rồi nói. Còn phương án A cũng có như a tài xế xe chở đá bẻ cua cứu 2 cô gái, và nếu cách đây chục năm chưa có fb thì ai cứu cuộc đời a?

Chơi Game

Xin chào mọi người. Mình là 1 sinh viên đang theo học kĩ thuật ô tô. Mình thấy ở vẫn đề này rất nhiều ý kiến cho rằng người đi bộ không đi qua vạch kẻ đường hay đúng quy định. Nhưng khi đi ở vùng quê thì hay trong ngõ thì không có vạch kẻ đường cho người đi bộ thì lỗicho ai ? Và ở quê thì tình trạng trẻ con chạy sồ ra ngoài đường thì xe nên sử lý thế nào?( nếu xe cố ý đi tiếp có khả năng sẽ gây chết người đó)

Lê Minh Hưng

Những người khác nếu muốn an toàn buộc phải sắm 1 AI khác "mạnh" hơn để di chuyển và tự bảo vệ mình.

Ghost Wolf

Với mình thì câu trả lời sẽ là cán người đi bộ.

Ở hầu hết các nước, người đi bộ chỉ được đi qua đường ở những đoạn có vạch kẻ, cố tình vi phạm rồi bị xe tông chết thì lỗi là do bạn ngu, ko thể trách người khác/ con AI được.

Ở những đoạn đường có vạch, thường thì oto sẽ giảm tốc và nhường cho người đi bộ đi trước (ít ra là ở những nơi mình đi qua thì hầu hết là như thế), AI hẳn là cũng sẽ được lập trình tương tự. Nếu AI của hãng nào đó cán người trong trường hợp này thì hãng phát triển nên bị kiện và phải bồi thường cho người bị nạn/ gia đình (tất nhiên là sẽ bắt buộc phải đi kèm với việc thu hồi lại xe đã bán để chỉnh sửa).

Nhưng nói chung vẫn sẽ là cán người đi bộ thay vì lao đầu vào tường để làm người ngồi trong xe gặp nguy hiểm, kể cả có là 1 đoàn người đi bộ thay vì 1 người. AI của xe luôn luôn phải được thiết kế để đảm bảo an toàn cho chủ của nó là người ngồi trong xe trước tiên. Hãng nào phát triển xe tự lái mà đám phát biểu là xe sẽ lao vào tường thì hẳn là sẽ sập tiệm đó.